Naviguer dans la gouvernance et l'assurance de l'IA : Les enjeux de la certification des systèmes de management de l'IA selon la norme ISO/IEC 42001

Ce livre blanc décrit la nécessité et la manière dont votre organisation peut développer, gouverner et se conformer en permanence aux exigences internes et externes pour faire progresser la mise en œuvre réussie de l'IA dans les procédures, les produits et les services.

L'intelligence artificielle (IA) transforme le monde et crée de nouvelles opportunités et de nouveaux défis pour les entreprises et la société de façon plus générale. Avec l'arrivée des IA Génératives ChatGPT et Copilot, l'expérimentation et les premières utilisations de l'IA dans les organisations ont explosé. Les mises en œuvre réussies montrent que l'IA peut renforcer l'efficacité, la qualité, l'innovation et la satisfaction des clients. Cependant, toute nouvelle technologie comporte des risques. L'IA présente de nombreux défis et incertitudes potentiels qu'il convient de maîtriser et d'atténuer pour assurer un déploiement, une application et une utilisation sûrs, fiables et éthiques.

Dans ce contexte, le rôle d'un système de management IA (AIMS) fondé sur la norme ISO/CEI 42001 devient essentiel pour que les organisations puissent maîtriser leur trajectoire en matière d'IA. Une approche structurée vous oblige à « réfléchir avant d'agir » et à évaluer en permanence les performances et les résultats. Cette norme fondamentale sur le management de l'IA, l'approche de la gestion des risques et la certification par une tierce partie est déjà reconnue comme un pilier essentiel pour encadrer le développement et fournir des solutions d'IA de confiance.

La nécessité d'une utilisation sécurisée et responsable de l'IA

La nécessité de disposer d'une IA fiable est motivée par l'expérimentation et le recours accrus à ses nombreuses applications, la prise de conscience et les attentes croissantes des parties prenantes, ainsi que l'évolution du cadre éthique et réglementaire. Les organisations ne pourront donc pas profiter des avantages de l'IA si le déficit de confiance entre les développeurs et les utilisateurs de l'IA n'est pas comblé. Le déficit de confiance fait référence au manque potentiel de confiance et de transparence dans les produits et/ou services de votre organisation basés sur l'IA. Lorsque les utilisateurs ne savent pas précisément comment les systèmes d'IA prennent leurs décisions, par exemple, il en résulte une incertitude et un scepticisme quant à la sécurité, aux considérations éthiques, à la protection de la confidentialité des données et à la fiabilité sur un plan général. En d'autres termes, notre confiance dans une technologie repose sur notre capacité à comprendre pleinement ses utilisations et à obtenir la garantie qu'elle est sécurisée et fiable.

Il est essentiel de combler ce déficit de confiance pour commercialiser et développer les produits et services issus de l'IA. Cela suppose que vous garantissiez une mise en œuvre sécurisée, responsable, fiable et éthique de l'IA. Cette garantie doit être fournie à la fois aux parties prenantes internes, telles que les employés et les cadres supérieurs, comme aux parties prenantes externes, telles que les clients et les actionnaires.

Pour parvenir à démontrer la fiabilité de vos solutions, il faut adopter une approche systématique couvrant l'ensemble du cycle de vie de l'IA, depuis l'analyse des parties prenantes, les garde-fous appropriés (comme les lignes directrices éthiques), la priorisation des cas d'utilisation et l'identification des risques, jusqu'à la mise en œuvre de contrôles pertinents. En se concentrant sur le déficit de confiance, il est possible d'identifier des besoins et des attentes clairs. Par exemple, votre organisation devrait :

- identifier et prioriser les domaines et les activités où l'IA peut apporter une valeur ajoutée et avoir un impact, et comprendre les avantages et les risques.

- établir et maintenir une culture de la confiance, de la transparence et de la responsabilité au sein des organisations.

- évaluer et mesurer les performances et la qualité des systèmes d'IA, et veiller à ce qu'ils soient conformes aux principes de fiabilité, à la législation existante ou à venir et aux exigences des clients.

- organiser les rôles et les attributions au sein des organisations, ce qui est crucial dans un domaine technologique qui ne cesse d'évoluer et de se développer

- adopter et mettre en œuvre des procédures fondées sur des normes de meilleures pratiques (par exemple, ISO/IEC 42001) pour le développement, la mise en œuvre et la gouvernance de l'IA.

- communiquer sur la fiabilité des systèmes d'IA aux parties prenantes, en fournissant des éléments de preuve et des garanties de conformité avec les meilleures pratiques, les lois et les réglementations.

Bien que non exhaustive, cette liste décrit les principaux besoins et attentes en la matière. La norme ISO/IEC 42001 relative aux Systèmes de Management de l'Intelligence Artificielle est conçue pour fournir des orientations et une structure permettant d'y répondre efficacement.

Le rôle de la standardisation dans la gouvernance de l'IA

Chaque nouvelle technologie s'accompagne de risques potentiels. L'évolution constante du paysage de l'IA, associée à l'énorme potentiel de son utilisation dans tous les secteurs, ne fait qu'accentuer ce phénomène. Il est impossible, par exemple, de prévoir tous les résultats lors de la phase de conception.

Dans ce contexte, les normes de systèmes de management telles que l'ISO/IEC 42001 prennent une place particulièrement importante. Dès lors qu'il y a un besoin de confiance de la part du grand public, la standardisation et la certification jouent un rôle central. Parallèlement aux considérations juridiques, réglementaires et éthiques, la standardisation fournit un vecteur pour permettre la flexibilité, incorporer la sécurisation et guider les organisations dans le territoire inconnu qu'est actuellement l'IA.

Les normes établissent une nomenclature essentielle, promeuvent des normes orientées par le secteur et saisissent les meilleures pratiques à des fins d'évaluation et d'amélioration. Procurant clarté et responsabilisation, les normes ciblant la management IA favoriseront grandement l'acceptation de la société. Elles offrent une base pour la conformité réglementaire et l'adoption par les entreprises et accélèrent la capacité à exploiter le potentiel mondial de l'IA de manière sécurisée, responsable et éthique tout en garantissant la transparence, la confiance et la sécurité nécessaires auprès des utilisateurs et des autres parties prenantes.

Le rôle des systèmes de management de l'IA

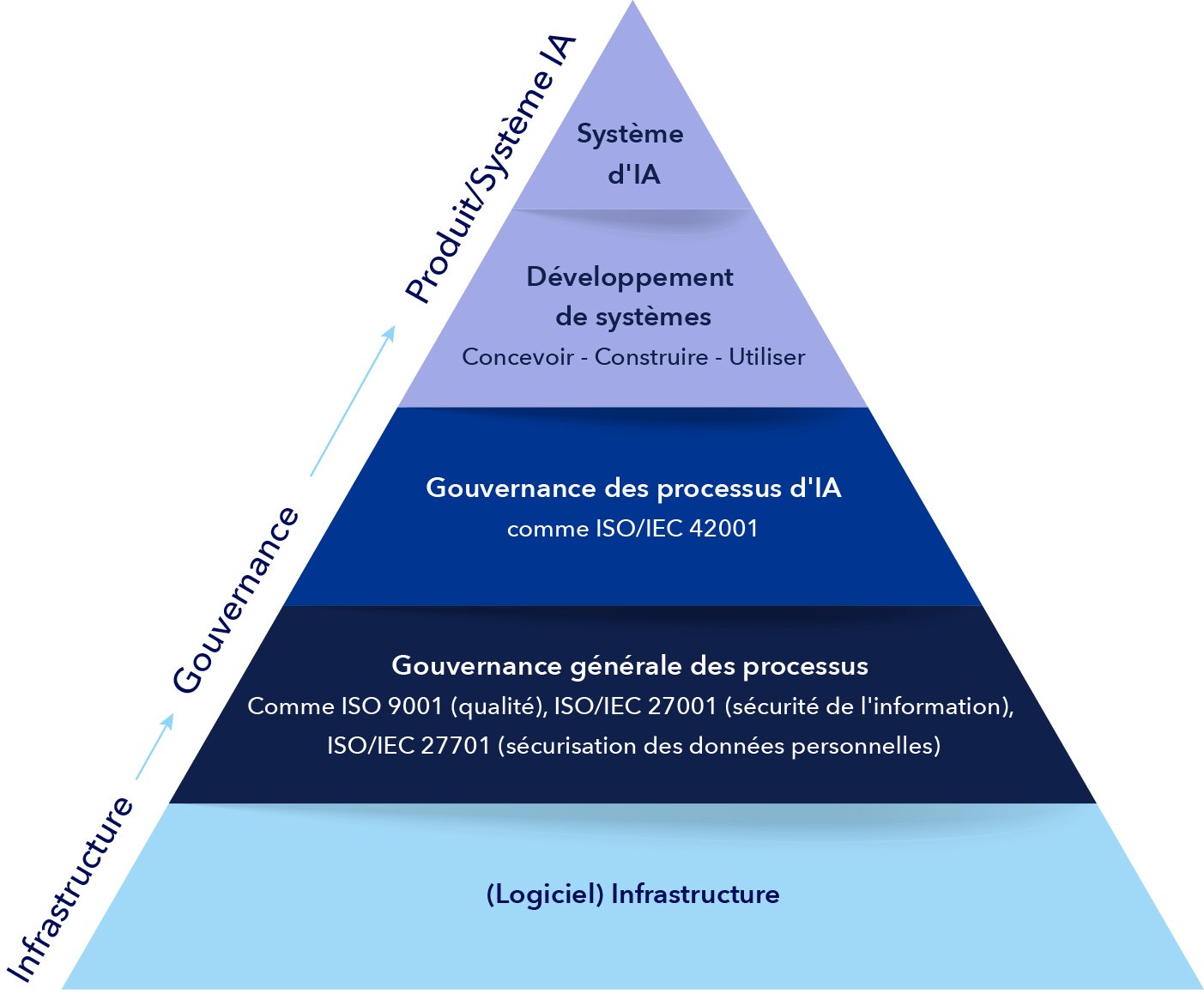

Les normes et la certification des systèmes de management peuvent servir de base solide aux organisations pour réunir leur gouvernance autour de l'IA (voir figure 1). La norme internationale pour les Systèmes de Management de l'IA, ISO/IEC 42001, fournit des orientations et des impératifs pour les organisations qui développent, déploient ou utilisent des systèmes d'IA.

Cette norme très attendue a été publiée fin 2023 et est applicable et destinée à être utilisée dans toutes les branches d'activité et par les organisations de tout type et de toute taille impliquées dans le développement, la fourniture ou l'utilisation de produits et/ou de services qui utilisent des systèmes d'IA. S'agissant d'une norme ISO, elle est compatible et complémentaire avec d'autres normes classiques de systèmes de management ISO, telles que la norme ISO 9001 (qualité) et la norme ISO/CEI 27001 (sécurité de l'information). L'ISO/CEI 42001 établit un équilibre entre la promotion de l'innovation en matière d'IA et la mise en œuvre d'une gouvernance efficace.

Cela signifie que vous pouvez vous appuyer sur tout système de gestion existant et sur la gouvernance générale des processus. Elle garantit une approche globale de la gouvernance sur la façon dont l'IA fait partie intégrante des produits, des services ou même des applications internes.

Dans le schéma ci-dessous, nous positionnons l'ISO/IEC 42001 comme un outil de gouvernance des procédures dans la « pyramide de garantie ». À la base de la pyramide se trouve l'infrastructure de référence de l'organisation. Tout ce qui doit être en place pour que l'organisation fonctionne. Afin de gouverner et d'améliorer, de nombreuses organisations choisissent de mettre en œuvre des systèmes de management conformes à la norme de qualité (ISO 9001), de sécurité de l'information (ISO/IEC 27001) ou à toute autre norme de système de management. La certification est alors le moyen de démontrer la conformité aux différentes parties prenantes.

Étant donné que la norme ISO/IEC 42001 suit une structure analogue à celle des autres normes de systèmes de management de l'ISO, elle permet de compléter votre système de management par les exigences relatives au système de management IA. Ainsi, la gouvernance de vos procédures constitue la base de la conception, de l'élaboration et de l'utilisation de systèmes d'intelligence artificielle fiables.

Les principaux objectifs de la norme ISO/IEC 42001 sont de :

- fournir un cadre et une méthodologie pour élaborer, déployer, entretenir et optimiser un système de management de l'IA, couvrant l'ensemble du cycle de vie de l'IA. Ce système adopte une approche fondée sur l'analyse des risques.

- permettre de démontrer et de communiquer sur la fiabilité des systèmes et des procédures d'IA d'une organisation.

- contribuer à la conformité réglementaire et légale, qui deviendra un élément de premier plan avec le renforcement des réglementations nationales et internationales, comme par exemple la Loi européenne sur l'IA prévue pour 2025.

- faciliter l'interopérabilité et l'intégration des systèmes et procédures d'IA

- promouvoir la coopération et la coordination entre les parties prenantes

- soutenir l'innovation et l'amélioration des systèmes et procédures d'IA

- encourager l'adoption et la diffusion des meilleures pratiques et normes en matière de management de l'IA.

Nous prévoyons des liens synergiques et réciproquement bénéfiques entre la norme ISO/CEI 42001 et les lois et réglementations sur l'IA. Alors que la Loi européenne sur l'IA est clairement axée sur les produits, l'adoption d'un système de management de l'IA fournit une base sur laquelle construire et fournir des systèmes d'IA de confiance homogènes et fiables, les contrôles de la norme sont conformes à ce que les réglementations exigent de respecter.

En définitive, un système de management bien déployé et conforme à toutes les normes pertinentes garantira l'intégrité, la confidentialité et l'utilisation éthique des données tout en étant suffisamment flexible pour intégrer les exigences en constante évolution émanant des clients, des avancées technologiques, ou encore par exemple des instances juridiques et réglementaires.

La voie à suivre ?

Pour amorcer le processus d'adoption d'un système de management certifié ISO/IEC 42001, vous pouvez utiliser l’article de DNV « 8 étapes vers la certification d'un système de management ISO/IEC 42001 » et l'outil d'auto-évaluation qui l'accompagne comme support d'orientation. La démarche commence par une évaluation de la direction générale afin d'identifier les principales raisons d'adopter un système de management de l'IA (AIMS). Ensuite, les organisations doivent se procurer la norme ISO/IEC 42001 et définir une orientation stratégique qui corresponde aux objectifs identifiés.

Les étapes suivantes comprennent la planification et l'affectation des ressources, la compréhension et la cartographie des processus clés et l'identification des besoins de formation du personnel. La préparation, le développement et la mise en œuvre des processus et procédures applicables sont des étapes classiques, et il est important d'appliquer des audits internes et des évaluations de management pour vérifier l'efficacité du système tout au long du processus. L'utilisation de l'outil d'auto-évaluation de DNV aidera à identifier les lacunes par rapport aux exigences de la norme et permettra une approche ciblée pour répondre aux exigences de l'ISO/IEC 42001.

Pourquoi choisir DNV ?

En tant qu'organisme de certification de pointe, DNV est le partenaire plebiscité par 80 000 organisations à travers le monde dans le cadre de la certification de leurs systèmes de management et de leurs besoins en matière de formation. Nous disposons de compétences uniques, d'une connaissance de l'industrie et de savoir-faire sur les systèmes de management de l'IA et autres systèmes de management. En choisissant DNV, vous bénéficiez :

- D’un acteur mondial de la sécurité de l'information et de la protection de la vie privée : Nous jouissons d'une solide expérience en matière de certification et de formation à la sécurité de l'information et à la protection de la vie privée, qu'il est essentiel d'intégrer dans votre management de l'IA.

- De la Risk Based Certification™ : Nous appliquons une approche proactive de la certification fondée sur l'analyse des risques, ce qui signifie que nous pouvons aider les organisations à identifier rapidement les risques potentiels dans leurs systèmes d'IA afin de s'assurer qu'ils sont traités avant de devenir un véritable problème.

- De Lumina™: Il s'agit de notre outil d'analyse comparative intelligent qui fournit des informations et des analyses plus approfondies sur le système de management, depuis les pannes les plus courantes et les réparations jusqu'à une supervision exhaustive de tous les sites de l'entreprise et des comparaisons avec d'autres organisations du même type.

- D’une Formation au management : Des solutions digitales pour aider votre entreprise à manager et à garantir une sensibilisation et un développement homogènes des compétences des employés dans l'ensemble de l'organisation.

- D'auditeurs compétents, qui adoptent une approche pragmatique, sont à l'écoute des besoins du client tout en veillant à ce que la conformité à la norme soit évaluée.

- Des méthodes de management de la clientèle structurées pour offrir une expérience client de qualité supérieure.

DNV s'engage à fournir des services d'assurance en IA fiables et à forte valeur ajoutée. En nous appuyant sur notre indépendance, notre rôle de tierce partie et notre politique de ne faire aucun compromis sur la qualité et l'intégrité, nous travaillons en partenariat avec nos clients pour les aider à naviguer dans les complexités de l'IA et des défis associés avec confiance et à assurer la gouvernance nécessaire pour fournir des systèmes d'IA dont on peut être certain qu'ils sont sûrs, fiables et sécurisés.